Agenci AI: Rewolucjonizowanie sztucznej inteligencji

W tym artykule zagłębimy się w świat agentów AI, badając ich fundamenty, architekturę oraz różne elementy składowe, które je tworzą. Przyjrzymy się również, jak można je integrować w różnych dziedzinach, jakie korzyści przynoszą oraz dlaczego te technologie przyciągają rosnące zainteresowanie w biznesie i wśród ogółu społeczeństwa.

Seria artykułów o AI

Oto pierwszy artykuł w czteroczęściowej serii:

- LLM: zrozumienie, czym są i jak działają (aktualny artykuł).

- NLP: eksploracja przetwarzania języka naturalnego.

- Agenci AI: spojrzenie na autonomiczne inteligencje sztuczne.

- Porównanie i pozycjonowanie AI Smarttalk: podsumowanie i perspektywa.

Wprowadzenie

W ostatnich latach sztuczna inteligencja (AI) zyskała na popularności, napędzana w szczególności przez demokratyzację potężnych modeli przetwarzania języka naturalnego (NLP) oraz dużych modeli językowych (LLM). Obecnie technologie te wykraczają poza zwykłe generowanie tekstu czy autouzupełnianie: rodzą bardziej złożone, bardziej autonomiczne systemy zdolne do działania i interakcji w imieniu użytkownika. Systemy te—powszechnie określane jako agenci AI—są zaprojektowane do obsługi wszelkiego rodzaju zadań, od prostego odpowiadania na często zadawane pytania po zarządzanie całym złożonym procesem.

Ale co tak naprawdę rozumiemy przez agenta AI? Jakie są technologiczne komponenty, które go tworzą? Jak agent AI potrafi zrozumieć prośby, rozumować i podejmować decyzje? Aby odpowiedzieć na te pytania, najpierw zdefiniujemy, czym jest agent AI, a następnie przyjrzymy się, jak działają jego silniki percepcji i decyzji. Zbadamy również kluczową rolę, jaką odgrywa wyszukiwanie wiedzy (lub Baza Wiedzy) oraz przydatność korzystania z narzędzi (wywołanie narzędzia) do wykonywania określonych działań. Na koniec zobaczymy, jak pamięć pomaga utrzymać kontekst i poprawić trafność interakcji w czasie.

Czym jest agent AI?

Agent AI to program komputerowy zdolny do podejmowania decyzji i wykonywania działań (lub, prościej, udzielania odpowiedzi) w sposób autonomiczny, opierając się na metodach sztucznej inteligencji. Agent jest zazwyczaj zaprojektowany do prowadzenia rozmowy z użytkownikiem (za pomocą tekstu lub głosu) i do realizacji konkretnych zadań, korzystając z zasobów zewnętrznych, baz wiedzy lub różnych narzędzi.

Agenci ci opierają się na przetwarzaniu języka naturalnego (NLP), aby zrozumieć prośby i komunikować się w sposób jasny. Jednak jeśli ograniczymy się do tradycyjnych podejść NLP, szybko napotkamy ograniczenia: konwencjonalny chatbot ma ograniczony słownik i stosunkowo sztywne zachowanie. Dlatego pojawiły się duże modele językowe (LLM), zdolne do rozumienia i generowania tekstu w znacznie bardziej zniuansowany sposób, niemal "ludzki".

Aby realizować swoje misje, agenci AI często włączają różne moduły uzupełniające. Jeden zajmuje się percepcją (lub rozumieniem języka), inny zajmuje się decyzją (lub planowaniem działań), a także istnieją moduły do wyszukiwania wiedzy i pamięci. Dodając do tego możliwość korzystania z zewnętrznych narzędzi, otrzymujemy systemy, które mogą naprawdę "działać" autonomicznie w danym środowisku.

Architektura modułowa

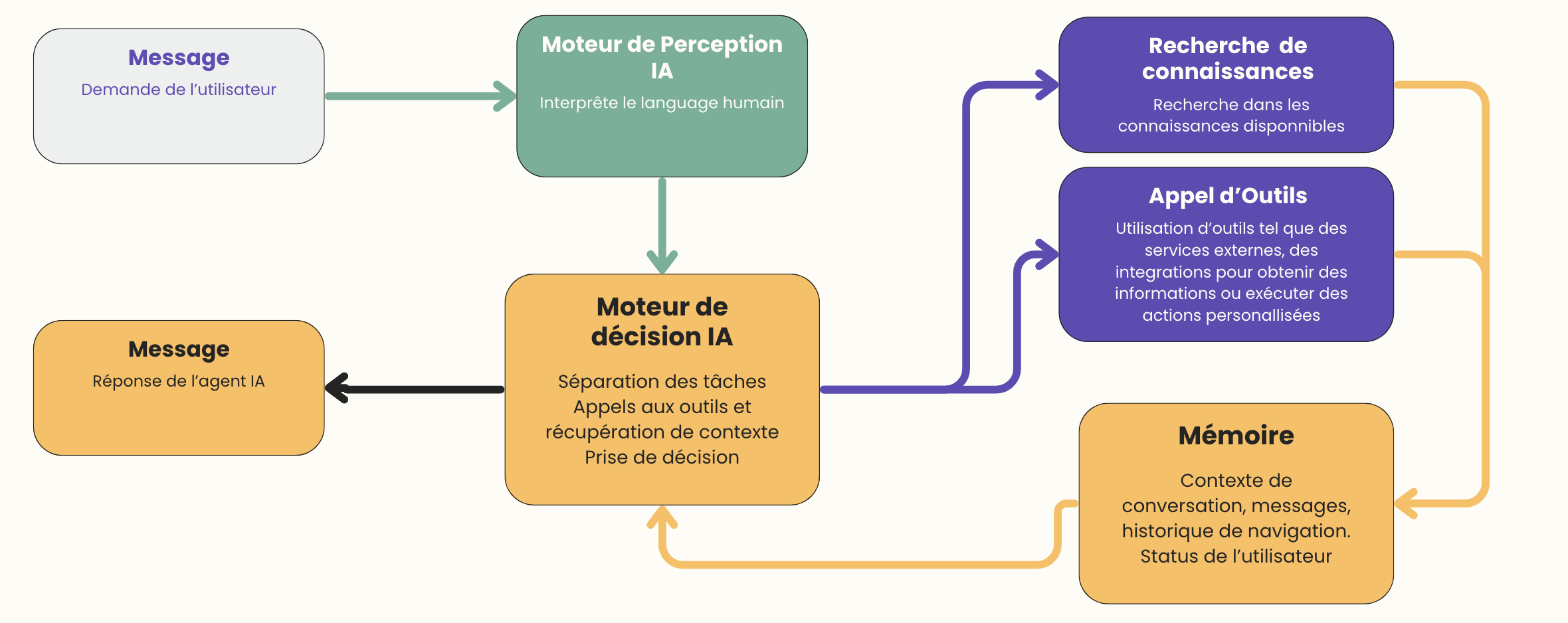

Aby wyjaśnić zasadę działania agenta AI, możemy zobrazować przepływ informacji w następujący sposób:

- Wiadomość (Prośba użytkownika): Użytkownik (ludzki) formułuje prośbę lub pytanie.

- Silnik percepcji: Silnik percepcji analizuje zdanie, identyfikuje intencję, kontekst i kluczowe elementy.

- Silnik decyzji: Silnik decyzji planuje niezbędne kroki, potencjalnie poszukuje dodatkowych informacji, korzysta z narzędzi, jeśli to konieczne, i przygotowuje odpowiedź lub działanie.

- Baza wiedzy: Moduł do przeszukiwania bazy wiedzy witryny lub firmy, lub w wzbogaconym czacie (RAG, indeksy, dokumenty itp.).

- Wywołanie narzędzia: Korzysta z zewnętrznego narzędzia do rozwiązania problemu, wysłania e-maila, zapytania API itp.

- Pamięć: Historia rozmowy, preferencje użytkownika, wyniki wcześniejszych działań itp.

- Wiadomość: Ostateczna odpowiedź wysyłana do użytkownika.

Każdy blok ma zatem swoją rolę do odegrania i może być wdrażany oddzielnie. Ta modułowość jest kluczowa, ponieważ pozwala na niezależne doskonalenie lub wymianę każdego komponentu w celu dostosowania do postępu technologicznego i specyficznych potrzeb każdej firmy lub projektu.

Silnik percepcji: Zrozumienie języka ludzkiego

Pierwszym istotnym elementem budulcowym agenta AI jest jego zdolność do rozumienia tego, co wyraża użytkownik. To jest rola silnika percepcji. Tam, gdzie tradycyjny chatbot mógł polegać na drzewie decyzyjnym (z ustalonymi słowami kluczowymi), obecny silnik percepcji często opiera się na LLM lub zaawansowanych algorytmach NLP.

Jak to działa?

- Analiza semantyczna: Silnik identyfikuje ogólną strukturę i znaczenie zdania.

- Ekstrakcja encji: Wyodrębnia kluczowe elementy (daty, lokalizacje, nazwy produktów itp.).

- Wykrywanie intencji: Próbuje rozpoznać cel prośby (np. "złożyć zamówienie", "poprosić o pomoc", "uzyskać informacje" itp.).

Dzięki LLM, te kroki stają się coraz dokładniejsze, nawet w złożonych przypadkach użycia lub gdy użytkownik nie wyraża się zbyt jasno. Dodatkowo, niektóre silniki percepcji określane są jako multimodalne: mogą obsługiwać nie tylko tekst, ale także obrazy, filmy czy nawet pliki audio.

Ograniczenia silnika percepcji

Pomimo znacznych postępów, rozumienie języka nigdy nie jest doskonałe. Obecne modele mogą być wprowadzane w błąd przez niejednoznaczne sformułowania lub oszukiwane przez nietypowe konteksty. Dlatego dobry agent AI powinien być w stanie zweryfikować swoje zrozumienie, zadając pytania wyjaśniające lub odwołując się do baz wiedzy, aby wzmocnić swoją początkową interpretację.

Silnik Decyzyjny: Orkiestracja Odpowiedzi i Działań

Gdy prośba została zrozumiana, ktoś musi zdecydować, co zrobić. To jest rola Silnika Decyzyjnego. Można go traktować jako dyrygenta, który otrzymuje partyturę (prośbę użytkownika, już przetworzoną przez Silnik Percepcji) i musi następnie:

- Podzielić zadanie na prostsze kroki (często określane jako „łańcuch myślenia” w terminologii AI).

- Określić, czy dodatkowe informacje muszą być uzyskane z baz danych, dokumentów, FAQ itp.

- Zdecydować, czy należy wywołać narzędzie (API, usługa zewnętrzna, działanie sprzętowe itp.), aby zrealizować prośbę.

- Złożyć ostateczną odpowiedź lub wynik (zaplanować sekwencję kroków, sformułować odpowiedź itp.).

Silnik Decyzyjny często polega również na LLM (Large Language Model) (lub dedykowanym silniku logicznym) dla bardziej wyrafinowanego rozumowania. Nie jest rzadkością zobaczyć systemy hybrydowe: jeden LLM do rozumienia języka, inny LLM do planowania i logiki, być może połączony z zakodowanymi zasadami biznesowymi.

Przykład: Jeśli klient wysyła wiadomość: „Chciałbym zmienić moje zamówienie numer 12345; jak to zrobić?”, Silnik Decyzyjny przetwarza te informacje jako prośbę o modyfikację zamówienia. Następnie:

- Sprawdzi, czy dostępne jest narzędzie do zarządzania zamówieniami,

- Określi kroki potrzebne do odzyskania zamówienia,

- Zweryfikuje status zamówienia (już wysłane czy nie),

- Wygeneruje spersonalizowaną odpowiedź,

- Możliwe, że uruchomi proces modyfikacji za pośrednictwem odpowiedniego API.

W ten sposób Silnik Decyzyjny działa jako operacyjny mózg, zapewniając spójność między wykrytymi intencjami a rzeczywistymi zadaniami wykonywanymi, korzystając z odpowiednich komponentów.

Baza Wiedzy: Wyszukiwanie Informacji

Centralnym punktem wielu agentów AI jest zdolność do wyszukiwania zewnętrznej wiedzy. Ta funkcjonalność jest często kluczowa, ponieważ, chociaż LLM może zapamiętać ogromne ilości informacji, czasami może brakować mu precyzji lub nie mieć najnowszej wersji wewnętrznej bazy danych.

Baza Wiedzy może przybierać różne formy:

- Wyszukiwanie w bazie dokumentów (np. zbiór plików PDF, podręczników, FAQ, dokumentów wewnętrznych).

- Wyszukiwanie w indeksie opartym na wektorach (często nazywanym RAG—Retrieval Augmented Generation), gdzie szuka się w osadzeniach semantycznych najbardziej odpowiedniego fragmentu, aby odpowiedzie�ć na zapytanie.

- Wyszukiwanie za pośrednictwem konwencjonalnej wyszukiwarki (Google, Bing itp. API).

- Konsultowanie wewnętrznych baz danych (CRM, ERP itp.).

W przypadku agenta AI do zarządzania zamówieniami, Baza Wiedzy może po prostu polegać na zapytaniu wewnętrznego systemu, aby znaleźć zamówienie nr 12345 i sprawdzić jego status (opłacone, oczekujące, wysłane itp.).

Zaletą tego modułu jest unikanie dostarczania niekompletnych lub nieprecyzyjnych odpowiedzi opartych wyłącznie na „ogólnej wiedzy” LLM. W ten sposób przechodzi się do udokumentowanego rozumowania, w którym agent (wewnętrznie) uzasadnia swoją odpowiedź wiarygodnymi i aktualnymi źródłami.

Wywołanie Narzędzia: Gdy AI Działa w Świecie

Odpowiadanie na pytania jest dobre, ale działanie w celu rozwiązania problemu jest jeszcze lepsze. To jest różnica między pasywnym chatbotem a agentem AI, który może podejmować konkretne działania.

Wywołanie Narzędzia odnosi się do wywołania zewnętrznego narzędzia lub usługi w celu przeprowadzenia operacji, takich jak:

- Wysłanie e-maila,

- Złożenie zamówienia,

- Aktualizacja pliku klienta,

- Uruchomienie skryptu,

- Modyfikacja kalendarza itp.

Dzięki tej zdolności agent AI może wykraczać poza zwykłą dyskusję i bezpośrednio rozwiązywać bieżący problem. Na przykład:

- Gdy użytkownik pyta: „Czy możesz zadzwonić do mojego dostawcy, aby przesunąć datę dostawy?”, agent AI może użyć API telefonii lub e-maila, aby skontaktować się z tym dostawcą.

- Gdy klient chce „Uzyskać zwrot za produkt X”, agent AI może rozpocząć procedurę zwrotu z odpowiednią usługą płatności lub logistyki.

Zasadniczo, Wywołanie Narzędzia daje agentowi AI pewien stopień „mocy działania” w cyfrowym środowisku. Oczywiście wymaga to, aby były wprowadzone bezpieczeństwo i kontrole, aby zapobiec nadużyciom lub złośliwym działaniom. Dostęp do narzędzi musi być regulowany i śledzony.

Pamięć: Śledzenie Historii i Preferencji

Kolejnym filarem skuteczności agenta AI jest jego pamięć. Ta pamięć może manifestować się na różne sposoby:

- Historia rozmowy: Agent pamięta wcześniejsze wymiany z użytkownikiem, co pozwala mu na spójne odpowiadanie w dłuższym kontekście.

- Wyniki wywołań narzędzi: Jeśli agent przeprowadził wyszukiwanie lub wykonał działanie, może zapisać wynik do późniejszego odniesienia.

- Preferencje lub profile użytkowników: Agent może zapamiętać gusta, potrzeby lub konkretne cechy klienta, aby spersonalizować swoje podejście w kolejnych interakcjach.

Ta pamięć jest niezbędna do zapewnienia „inteligentnego” doświadczenia użytkownika. Chatbot bez pamięci miałby tendencję do zapominania, co właśnie powiedziano, co prowadziłoby do powtórzeń lub zadawania tych samych pytań. Z drugiej strony, agent AI z solidną pamięcią może budować zaufanie, utrzymując spójną historię rozmowy i unikając wielokrotnego zadawania tych samych pytań.

Od Prostej FAQ do Agenta AI: Rewolucja w Toku

Przez długi czas chatboty były niewiele więcej niż dynamicznymi FAQ: lista stałych pytań i odpowiedzi, podstawowe skrypty i ograniczona personalizacja. Pojawienie się LLM zmieniło zasady gry, umożliwiając:

- Znacznie bardziej zniuansowane rozumienie języka: Użytkownicy mogą mówić naturalnie, a agent AI może (często) ich zrozumieć i w razie potrzeby przeformułować ich intencje.

- Bardziej bogate, kontekstowe generowanie tekstu: Agent AI może wyjaśniać, argumentować, opowiadać historie itp., w płynny, odpowiedni sposób.

- Elastyczność i uczenie się: Dzięki danym i zgromadzonej pamięci agent może poprawiać swoje odpowiedzi lub dostosowywać swoje działania.

Jednak prawdziwa rewolucja nie polega tylko na zastąpieniu prostego chatbota „super-chatbotem”. Kluczowa zmiana polega na tym, że agent AI może, za pośrednictwem modułów decyzyjnych i wywołań narzędzi, bezpośrednio interweniować w cyfrowym środowisku. Może orkiestracja operacji, interakcja z systemami informacyjnymi, a tym samym dostarczać kompletny i proaktywny poziom wsparcia lub pomocy dla klientów.

Konkretne Przykłady Zastosowań

1. Obsługa Klienta i Wsparcie Posprzedażowe

W tej dziedzinie agent AI może:

- Zrozumieć skargę użytkownika dotyczącą wadliwego produktu,

- Zweryfikować informacje o gwarancji i fakturze w bazie danych,

- Inicjować zwrot produktu (Tool Call) poprzez utworzenie zgłoszenia logistycznego,

- Zaktualizować kartę klienta, rejestrując roszczenie,

- Poinformować użytkownika o procedurze, którą należy wykonać (lub nawet wysłać mu e-mail z potwierdzeniem).

Rezultat: całodobowa obsługa klienta, oferująca jednolite i szybkie doświadczenie oraz zwalniająca czas dla ludzkich agentów, którzy mogą skupić się na bardziej złożonych sprawach.

2. Asystent Sprzedaży i Marketingu

Wyobraź sobie asystenta AI zdolnego do:

- Zrozumienia dokładnych potrzeb klienta (konkretny produkt, oferta promocyjna itp.),

- Sprawdzenia katalogu produktów i dostępności,

- Zaproponowania alternatywnego produktu, jeśli pierwszy wybór jest niedostępny,

- Zainicjowania zamówienia lub przygotowania wyceny,

- Wysłania e-maila z potwierdzeniem i podsumowaniem.

Ten agent AI działa jako wirtualny super-sprzedawca, prowadząc klienta przez jego ścieżkę zakupową — od początkowego zbierania informacji po finalizację transakcji.

3. Zaawansowane Wsparcie Techniczne

Agent AI może:

- Przeszukiwać wewnętrzne bazy wiedzy (przewodniki techniczne, instrukcje, FAQ), aby znaleźć najbardziej odpowiednie rozwiązanie,

- Zadawać ukierunkowane pytania użytkownikowi, aby lepiej zrozumieć charakter problemu,

- Sugerować kroki rozwiązywania problemów (a być może uruchomić zdalne narzędzie diagnostyczne),

- Aktualizować zgłoszenie wsparcia i informować klienta o jego postępach.

Ten scenariusz jest szczególnie przydatny w dziedzinie IT lub w zaawansowanej obsłudze posprzedażowej, gdzie złożoność pytań wymaga głębokiego zrozumienia problemu i umiejętności znalezienia odpowiednich informacji technicznych.

4. Automatyzacja Zadań Administracyjnych

Agent AI może:

- Automatycznie wypełniać formularze administracyjne,

- Ekstrahować dane z dokumentów (faktury, umowy itp.),

- Aktualizować rekordy w programie HR lub księgowym,

- Umawiać spotkania (Tool Call do wspólnego kalendarza),

- Wysyłać przypomnienia lub powiadomienia.

Ta automatyzacja znacznie redukuje obciążenie powtarzalnymi zadaniami dla zespołów, umożliwiając im skoncentrowanie się na misjach o wyższej wartości.

Wyzwania i Rozważania

Chociaż obietnica agentów AI jest przekonująca, pozostaje kilka wyzwań:

- Jakość modelu percepcyjnego: Nawet najlepsze LLM mogą popełniać błędy, wymyślać odpowiedzi lub źle interpretować zapytania.

- Zachowanie spójności w czasie: Im dłuższa rozmowa, tym więcej agent musi zarządzać dużym kontekstem i unikać niespójności.

- Problemy etyczne i bezpieczeństwa: Nadanie agentowi AI zdolności do działania oznacza potencjalne udzielenie mu dostępu do wrażliwych danych lub krytycznych funkcji (płatności, oficjalne e-maile itp.). Stąd potrzeba zabezpieczeń.

- Zależność od infrastruktury: Niezawodność agenta AI zależy od solidności hostingu i jakości używanych API stron trzecich.

Aby sprostać tym wyzwaniom, organizacje często wdrażają hybrydowe rozwiązania, w których agent AI działa do pewnego progu, a następnie przekazuje wrażliwe działania do ludzkiego operatora w celu zatwierdzenia. Można również rejestrować wszystkie zapytania i odpowiedzi, aby przeprowadzać audyty w przypadku wystąpienia problemu.

Dlaczego Warto Zainwestować w Agenta AI?

Pomimo potencjalnych ograniczeń i ryzyk, coraz więcej firm decyduje się na rozwój lub integrację agenta AI. Oto niektóre z głównych zalet:

- Poprawa doświadczenia klienta: Agent AI może być dostępny 24/7, odpowiadać szybko i spójnie oraz personalizować swoje odpowiedzi, korzystając z pamięci użytkownika.

- Optymalizacja kosztów: Automatyzując niektóre zadania, zmniejszasz obciążenie dla swoich zespołów i zyskujesz na wydajności.

- Oszczędność czasu: Agent AI może obsługiwać dużą liczbę zapytań równolegle, bez zmęczenia, przekazując jednocześnie złożone sprawy ludziom.

- Innowacyjność i różnicowanie: Inteligentna obsługa klienta może stanowić silny argument marketingowy.

- Lepsze zbieranie danych: Agent AI może rejestrować historie rozmów i wyciągać użyteczne statystyki (trendy pytań, wskaźniki satysfakcji itp.).

Kluczowe Zasady Wdrażania Efektywnego Agenta AI

- Zdefiniuj zakres i cele: Jakie zadania agent ma obsługiwać? Jakie działania powinien być w stanie wykonać? Jaką autonomię będzie miał?

- Wybierz lub wytrenuj modele: Użyj istniejących LLM (dostarczanych przez głównych graczy) lub wytrenuj własny model na danych wewnętrznych.

- Włącz moduł „decyzyjny”: Ustal logikę biznesową, zasady i sposób, w jaki agent koordynuje różne wywołania narzędzi.

- Połącz z bazami wiedzy: Ustaw solidną infrastrukturę Bazy Wiedzy — być może za pomocą indeksu wektorowego lub wewnętrznego systemu FAQ.

- Zabezpiecz i nadzoruj: Zarządzaj prawami dostępu do narzędzi i ustaw monitoring odpowiedzi i działań agenta.

- Zastanów się nad doświadczeniem użytkownika: Upewnij się, że agent komunikuje się płynnie i grzecznie oraz potrafi zadawać pytania wyjaśniające w razie wątpliwości.

Rola Integracji Omnichannel

Agent AI musi być również tam, gdzie znajdują się użytkownicy. Oznacza to, że powinien być w stanie integrować się z:

- stroną internetową (w formie widgetu lub czatu),

- platformami komunikacyjnymi (Messenger, Instagram, WhatsApp, Discord, Slack itp.),

- prywatną przestrzenią dla klientów (intranety, extranety),

- oprogramowaniem biznesowym (CRM, ERP, helpdesk).

Dzięki tym wielokrotnym integracjom agent AI staje się jednym punktem kontaktu, dostarczając spójność i ciągłość w relacjach z klientami, niezależnie od używanego kanału. To podejście nazywane jest omnichannel, które upraszcza ścieżkę użytkownika i zwiększa ogólne zadowolenie.

Przykłady Typowych Interakcji

Aby zobrazować, rozważmy hipotetyczny scenariusz, w którym użytkownik kontaktuje się z agentem AI za pośrednictwem strony e-commerce:

- Użytkownik: „Cześć, otrzymałem e-mail zapraszający mnie do wypróbowania waszej nowej usługi, ale nie rozumiem, jak to działa.”

- Agent AI: (Percepcja) Rozumie, że to pytanie dotyczące konkretnej usługi. (Decyzja) Sprawdza, czy dostępna jest dokumentacja wewnętrzna. (Baza Wiedzy) Znajduje artykuł wyjaśniający, jak to działa. (Odpowiada) „Cześć, widzę, że masz pytania dotyczące naszej nowej usługi. Oto kroki…”

- Użytkownik: „Dobrze, ale gdzie mogę ustawić swoje preferencje?”

- Agent AI: (Decyzja) Identyfikuje potrzebę aktualizacji profilu. (Tool Call) Oferuje link lub wykonuje skrypt, aby otworzyć stronę preferencji. „Możesz zaktualizować swoje preferencje pod tym linkiem. Czy chciałbyś, żebym przekierował cię tam bezpośrednio?”

- Użytkownik: „Tak, dziękuję.”

- Agent AI: (Pamięć) Zachowuje fakt, że użytkownik zaktualizował swoje preferencje, co będzie przydatne później do spersonalizowanych rekomendacji.

W tej wymianie możemy zobaczyć interakcję między percepcją, decyzją, pozyskiwaniem wiedzy i wywołaniami narzędzi, wszystko archiwizowane w pamięci agenta do przyszłego odniesienia.

Przyszłe Perspektywy

Agenci AI mają się dalej rozwijać, dzięki:

- Udoskonalonym LLM: Bardziej dokładne modele z lepszym zrozumieniem kontekstu i bardziej zaawansowanym rozumowaniem.

- Większej multimodalności: Umożliwiającej agentowi AI przetwarzanie obrazów, wideo, dźwięku, a nie tylko tekstu.

- Ciągłemu uczeniu się: Pozwalającemu agentowi uczyć się w czasie rzeczywistym na podstawie nowych danych lub interakcji.

- Personalizacji: Wykorzystaniu szczegółowych profili użytkowników, połączonych z obszernymi historiami, aby dostarczyć hiperpersonalizowane doświadczenie.

- Pojawieniu się platform no-code: Ułatwiającemu projektowanie i wdrażanie agentów AI, nawet dla użytkowników nietechnicznych.

W niedalekiej przyszłości można sobie wyobrazić, że każda firma będzie miała swój własny ekosystem wyspecjalizowanych agentów AI: jeden do sprzedaży, inny do wsparcia technicznego, trzeci do zarządzania wewnętrznego itd. Agenci ci mogliby współpracować, dzieląc się odpowiednimi informacjami w celu usprawnienia doświadczeń klientów i wewnętrznej produktywności.

Podsumowanie

Agenci AI stanowią znaczący postęp w dziedzinie zastosowanej sztucznej inteligencji. O wiele więcej niż prosty chatbot, agent AI potrafi zrozumieć intencje użytkownika, podejmować świadome decyzje, korzystać z zewnętrznych narzędzi i ciągle się doskonalić dzięki pamięci kontekstowej.

W miarę jak technologia się rozwija, granica między wirtualnym asystentem, zautomatyzowanym doradcą a cyfrowym współpracownikiem zacznie się zacierać. Postęp w NLP i LLM już teraz umożliwia rozwijanie agentów, którzy obsługują szeroki wachlarz przypadków użycia — od obsługi klienta po zarządzanie złożonymi procesami biznesowymi.

Mając to na uwadze, kluczowe jest projektowanie agentów AI, którzy są solidni, bezpieczni i zdolni do płynnej integracji z istniejącym środowiskiem. Wyzwania związane z zarządzaniem, niezawodnością i etyką nie mogą być lekceważone, jednak nie umniejszają one zysków z produktywności, ulepszonego doświadczenia klienta oraz innowacyjnej zdolności, jakie oferują te technologie.

Dla organizacji i deweloperów to wyjątkowa okazja, aby wyróżnić się, oferując inteligentne rozwiązania, które naprawdę odpowiadają potrzebom użytkowników od początku do końca, wykorzystując wszystko, co nowoczesna AI ma do zaoferowania. Wraz z rozwojem platform no-code i łatwą integracją w różnych kanałach, możemy oczekiwać, że agenci AI szybko staną się standardem w relacjach z klientami i transformacji cyfrowej w firmach.

Podsumowując, skuteczne wdrożenie agenta AI opiera się na umiejętnym połączeniu technologii, wiedzy biznesowej, strategii integracji oraz wizji długoterminowej. Możliwości są ogromne, a ci, którzy je wykorzystają, będą w stanie rozwijać nowe usługi, nowe doświadczenia i nowe sposoby interakcji z użytkownikami, partnerami i pracownikami. Historia dopiero się zaczyna, a nie ma wątpliwości, że agenci AI będą nadal rosnąć w dojrzałości i wyrafinowaniu — stopniowo redefiniując, jak podchodzimy do komunikacji, współpracy i automatyzacji zarówno w naszym życiu zawodowym, jak i osobistym.