KI-Agenten: Revolutionierung der Künstlichen Intelligenz

In diesem Artikel werden wir tief in die Welt der KI-Agenten eintauchen, ihre Grundlagen, ihre Architektur und die verschiedenen Bausteine, aus denen sie bestehen, erkunden. Wir werden auch betrachten, wie sie in verschiedenen Bereichen integriert werden können, welche Vorteile sie bieten und warum diese Technologien zunehmend das Interesse von Unternehmen und der Öffentlichkeit auf sich ziehen.

Artikelreihe über KI

Hier ist der erste Artikel einer vierteiligen Serie:

- LLMs: Verständnis, was sie sind und wie sie funktionieren (aktueller Artikel).

- NLP: eine Erkundung der Verarbeitung natürlicher Sprache.

- KI-Agenten: ein Blick auf autonome künstliche Intelligenzen.

- Vergleich und Positionierung von AI Smarttalk: eine Zusammenfassung und Perspektive.

Einführung

In den letzten Jahren hat die künstliche Intelligenz (KI) zunehmend an Popularität gewonnen, insbesondere durch die Demokratisierung leistungsstarker Modelle zur Verarbeitung natürlicher Sprache (NLP) und großer Sprachmodelle (LLMs). Heutzutage gehen diese Technologien über bloße Textgenerierung oder Autovervollständigung hinaus: Sie führen zu komplexeren, autonomeren Systemen, die in der Lage sind, im Namen des Benutzers zu handeln und zu interagieren. Diese Systeme—häufig als KI-Agenten bezeichnet—sind darauf ausgelegt, alle Arten von Aufgaben zu bewältigen, von der Beantwortung häufiger Fragen bis hin zur Verwaltung eines gesamten komplexen Prozesses.

Aber was verstehen wir wirklich unter KI-Agent? Was sind die technologischen Komponenten, aus denen er besteht? Wie gelingt es einem KI-Agenten, Anfragen zu verstehen, zu schlussfolgern und Entscheidungen zu treffen? Um diese Fragen zu beantworten, werden wir zunächst definieren, was ein KI-Agent ist, und dann untersuchen, wie seine Wahrnehmungs- und Entscheidungs-Engines interagieren. Wir werden auch die Schlüsselrolle der Wissensretrieval (oder Wissensdatenbank) und die Nützlichkeit der Inanspruchnahme von Werkzeugen (dem Tool Call) zur Durchführung spezifischer Aktionen betrachten. Schließlich werden wir sehen, wie Gedächtnis dazu beiträgt, den Kontext aufrechtzuerhalten und die Relevanz von Interaktionen im Laufe der Zeit zu verbessern.

Was ist ein KI-Agent?

Ein KI-Agent ist ein Softwareprogramm, das in der Lage ist, Entscheidungen zu treffen und Aktionen (oder einfacher gesagt, Antworten) autonom durchzuführen, wobei es auf Methoden der künstlichen Intelligenz zurückgreift. Der Agent ist in der Regel darauf ausgelegt, mit einem Benutzer (über Text oder Sprache) zu kommunizieren und spezifische Aufgaben unter Verwendung externer Ressourcen, Wissensdatenbanken oder verschiedener Werkzeuge auszuführen.

Diese Agenten stützen sich auf Verarbeitung natürlicher Sprache (NLP), um Anfragen zu verstehen und klar zu kommunizieren. Wenn wir uns jedoch auf traditionelle NLP-Ansätze beschränken, stoßen wir schnell auf Einschränkungen: Ein herkömmlicher Chatbot hat einen eingeschränkten Wortschatz und ein relativ starres Verhalten. Deshalb sind große Sprachmodelle (LLMs) entstanden, die in der Lage sind, Text auf eine viel nuanciertere, fast „menschliche“ Weise zu verstehen und zu generieren.

Um ihre Aufgaben zu erfüllen, integrieren KI-Agenten oft verschiedene komplementäre Module. Eines kümmert sich um die Wahrnehmung (oder Sprachverständnis), ein anderes um die Entscheidung (oder Planung von Aktionen), und es gibt auch Module für Wissensretrieval und Gedächtnis. Fügen Sie die Fähigkeit hinzu, externe Werkzeuge in Anspruch zu nehmen, und Sie erhalten Systeme, die tatsächlich autonom in einer gegebenen Umgebung „handeln“ können.

Eine Modulare Architektur

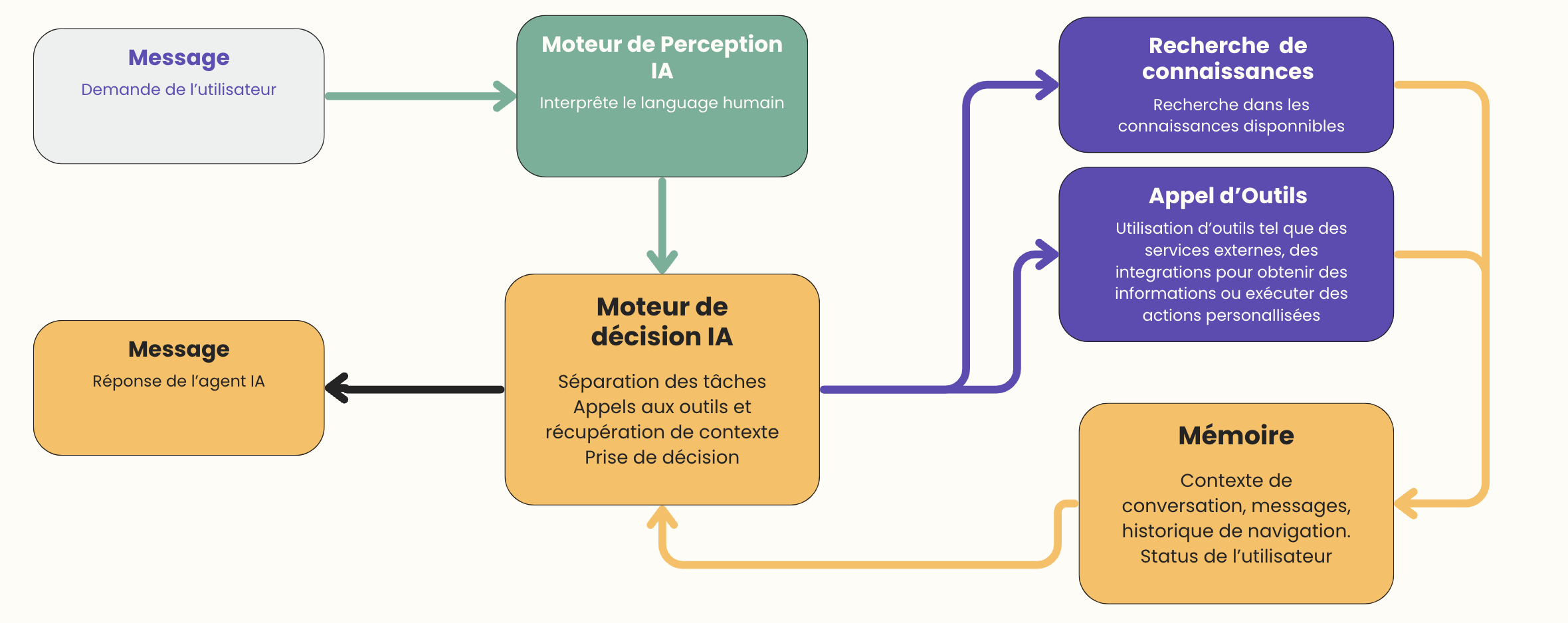

Um das Funktionsprinzip eines KI-Agenten zu erklären, können wir den Informationsfluss wie folgt visualisieren:

- Nachricht (Anfrage des Benutzers): Der (menschliche) Benutzer formuliert eine Anfrage oder Frage.

- Wahrnehmungs-Engine: Die Wahrnehmungs-Engine analysiert den Satz, identifiziert die Absicht, den Kontext und die Schlüsselfaktoren.

- Entscheidungs-Engine: Die Entscheidungs-Engine plant die notwendigen Schritte, sucht möglicherweise nach zusätzlichen Informationen, ruft bei Bedarf Werkzeuge auf und bereitet eine Antwort oder Aktion vor.

- Wissensdatenbank: Ein Modul zur Durchsuchung der Wissensdatenbank einer Website oder eines Unternehmens oder in einem erweiterten Chatbot (RAG, Indizes, Dokumente usw.).

- Tool Call: Ruft ein externes Werkzeug auf, um ein Problem zu lösen, eine E-Mail zu senden, eine API abzufragen usw.

- Gedächtnis: Die Historie der Konversation, Benutzerpräferenzen, Ergebnisse früherer Aktionen usw.

- Nachricht: Die endgültige Antwort, die an den Benutzer zurückgesendet wird.

Jeder Block hat somit seine Rolle zu spielen und kann separat implementiert werden. Diese Modularität ist entscheidend, da sie die unabhängige Verbesserung oder den Austausch jeder Komponente ermöglicht, um sich an technologische Entwicklungen und die spezifischen Bedürfnisse jedes Unternehmens oder Projekts anzupassen.

Die Wahrnehmungs-Engine: Verständnis der menschlichen Sprache

Der erste wesentliche Baustein für einen KI-Agenten ist seine Fähigkeit, das, was der Benutzer ausdrückt, zu verstehen. Dies ist die Rolle der Wahrnehmungs-Engine. Wo ein traditioneller Chatbot möglicherweise auf einen Entscheidungsbaum (mit festen Schlüsselwörtern) angewiesen war, basiert eine aktuelle Wahrnehmungs-Engine oft auf einem LLM oder auf fortschrittlichen NLP-Algorithmen.

Wie funktioniert es?

- Semantische Analyse: Die Engine identifiziert die Gesamtstruktur und die Bedeutung des Satzes.

- Entitätsextraktion: Sie extrahiert Schlüsselfaktoren (Daten, Standorte, Produktnamen usw.).

- Absichtserkennung: Sie versucht, den Zweck der Anfrage zu erkennen (z. B. „eine Bestellung aufgeben“, „um Hilfe bitten“, „Informationen erhalten“ usw.).

Dank der LLMs werden diese Schritte immer genauer, selbst in komplexen Anwendungsfällen oder wenn der Benutzer sich nicht sehr klar ausdrückt. Darüber hinaus werden einige Wahrnehmungs-Engines als multimodal bezeichnet: Sie können nicht nur Text, sondern auch Bilder, Videos oder sogar Audiodateien verarbeiten.

Die Grenzen der Wahrnehmungs-Engine

Trotz erheblicher Fortschritte ist das Sprachverständnis nie perfekt. Aktuelle Modelle können durch mehrdeutige Formulierungen in die Irre geführt oder durch ungewöhnliche Kontexte getäuscht werden. Deshalb sollte ein guter KI-Agent in der Lage sein, sein Verständnis zu überprüfen, indem er Klarstellungsfragen stellt oder auf Wissensdatenbanken zurückgreift, um seine ursprüngliche Interpretation zu untermauern.

Die Entscheidungsmaschine: Orchestrierung der Antworten und Aktionen

Sobald die Anfrage verstanden wurde, muss jemand entscheiden, was zu tun ist. Dies ist die Rolle der Entscheidungsmaschine. Man kann sie sich wie einen Dirigenten vorstellen, der die Partitur (die Anfrage des Benutzers, bereits vom Wahrnehmungsmodul verarbeitet) erhält und dann:

- Die Aufgabe in einfachere Schritte zerlegen (oft als „Chain-of-Thought“ in der KI-Terminologie bezeichnet).

- Bestimmen, ob zusätzliche Informationen aus Datenbanken, Dokumenten, FAQs usw. beschafft werden müssen.

- Entscheiden, ob ein Werkzeug (API, externer Dienst, Hardware-Aktion usw.) aufgerufen werden muss, um die Anfrage zu erfüllen.

- Die endgültige Antwort oder das Ergebnis zusammenstellen (die Reihenfolge der Schritte planen, die Antwort formulieren usw.).

Die Entscheidungsmaschine verlässt sich oft auch auf ein LLM (oder eine dedizierte Logikmaschine) für verfeinerte Überlegungen. Es ist nicht ungewöhnlich, hybride Systeme zu sehen: ein LLM für das Sprachverständnis, ein anderes LLM für Planung und Logik, möglicherweise gekoppelt mit codierten Geschäftsregeln.

Beispiel: Wenn ein Kunde eine Nachricht sendet: „Ich möchte meine Bestellnummer 12345 ändern; wie mache ich das?“, verarbeitet die Entscheidungsmaschine diese Information als Anfrage zur Modifikation einer Bestellung. Sie wird dann:

- Überprüfen, ob ein Bestellmanagement-Tool verfügbar ist,

- Die Schritte herausfinden, die erforderlich sind, um die Bestellung abzurufen,

- Den Status der Bestellung überprüfen (bereits versandt oder nicht),

- Eine personalisierte Antwort generieren,

- Möglicherweise den Änderungsprozess über die relevante API starten.

Somit fungiert die Entscheidungsmaschine als operatives Gehirn, das Konsistenz zwischen den erkannten Absichten und den tatsächlich durchgeführten Aufgaben gewährleistet, indem sie die entsprechenden Komponenten verwendet.

Wissensdatenbank: Suche nach Informationen

Zentral für viele KI-Agenten ist die Fähigkeit, externe Kenntnisse abzurufen. Diese Funktionalität ist oft entscheidend, denn obwohl ein LLM enorme Mengen an Informationen gespeichert haben kann, kann es manchmal an Präzision mangeln oder nicht die neueste Version einer internen Datenbank haben.

Die Wissensdatenbank kann verschiedene Formen annehmen:

- Durchsuchen einer Dokumentenbasis (z. B. eine Sammlung von PDFs, Handbüchern, FAQs, internen Dokumenten).

- Durchsuchen eines vektorbasierten Index (oft als RAG—Retrieval Augmented Generation bezeichnet), bei dem innerhalb semantischer Einbettungen nach dem relevantesten Abschnitt gesucht wird, um die Anfrage zu beantworten.

- Suche über eine herkömmliche Suchmaschine (Google, Bing usw. API).

- Abfragen interner Datenbanken (CRM, ERP usw.).

Im Beispiel eines KI-Agenten für das Bestellmanagement könnte die Wissensdatenbank einfach darin bestehen, das interne System abzufragen, um die Bestellung #12345 zu finden und ihren Status (bezahlt, ausstehend, versandt usw.) zu überprüfen.

Der Vorteil dieses Moduls besteht darin, unvollständige oder ungenaue Antworten zu vermeiden, die ausschließlich auf dem „Allgemeinwissen“ des LLM basieren. Man bewegt sich somit in Richtung dokumentierter Argumentation, bei der der Agent (intern) seine Antwort mit zuverlässigen und aktuellen Quellen rechtfertigt.

Werkzeugaufruf: Wenn KI in der Welt handelt

Fragen zu beantworten ist gut, aber zu handeln, um ein Problem zu lösen, ist noch besser. Das ist der Unterschied zwischen einem passiven Chatbot und einem KI-Agenten, der konkrete Aktionen durchführen kann.

Der Werkzeugaufruf bezieht sich auf den Aufruf eines externen Werkzeugs oder Dienstes, um eine Operation durchzuführen, wie z. B.:

- Eine E-Mail senden,

- Eine Bestellung aufgeben,

- Eine Kundenakte aktualisieren,

- Ein Skript ausführen,

- Einen Kalender ändern usw.

Dank dieser Fähigkeit kann ein KI-Agent über bloße Diskussionen hinausgehen und das aktuelle Problem direkt lösen. Zum Beispiel:

- Wenn ein Benutzer fragt: „Kannst du meinen Lieferanten anrufen, um das Lieferdatum zu verschieben?“, kann der KI-Agent eine Telefon- oder E-Mail-API verwenden, um diesen Lieferanten zu kontaktieren.

- Wenn ein Kunde möchte, „Eine Rückerstattung für Produkt X zu erhalten“, kann der KI-Agent das Rückerstattungsverfahren mit dem relevanten Zahlungs- oder Logistikdienst einleiten.

Im Wesentlichen verleiht der Werkzeugaufruf dem KI-Agenten einen Grad an „Handlungsmacht“ innerhalb der digitalen Umgebung. Natürlich erfordert dies, dass Sicherheits- und Kontrollmechanismen vorhanden sind, um Missbrauch oder böswillige Aktionen zu verhindern. Der Zugang zu Werkzeugen muss reguliert und nachvollziehbar sein.

Gedächtnis: Verfolgen von Geschichte und Vorlieben

Ein weiterer Pfeiler der Effektivität eines KI-Agenten ist sein Gedächtnis. Dieses Gedächtnis kann sich auf verschiedene Weise manifestieren:

- Gesprächshistorie: Der Agent erinnert sich an frühere Austausche mit dem Benutzer, was ihm ermöglicht, in einem längeren Kontext kohärent zu antworten.

- Ergebnisse von Werkzeugaufrufen: Wenn der Agent eine Suche durchgeführt oder eine Aktion ausgeführt hat, kann er das Ergebnis für spätere Referenzen speichern.

- Benutzervorlieben oder -profile: Der Agent kann sich die Vorlieben, Bedürfnisse oder spezifischen Merkmale eines Kunden merken, um seinen Ansatz in zukünftigen Interaktionen zu personalisieren.

Dieses Gedächtnis ist entscheidend für die Bereitstellung einer „intelligenten“ Benutzererfahrung. Ein Chatbot ohne Gedächtnis würde dazu tendieren, zu vergessen, was gerade gesagt wurde, was zu Wiederholungen oder wiederholten Fragen führen würde. Ein KI-Agent mit robustem Gedächtnis kann hingegen Vertrauen aufbauen, indem er eine kohärente Gesprächshistorie aufrechterhält und vermeidet, immer wieder die gleichen Fragen zu stellen.

Vom einfachen FAQ zum KI-Agenten: Eine Revolution im Gange

Lange Zeit waren Chatbots nicht viel mehr als dynamische FAQs: eine Liste fester Fragen und Antworten, grundlegende Skripte und begrenzte Personalisierung. Das Aufkommen von LLMs hat das Spiel verändert, indem es ermöglicht hat:

- Ein viel nuancierteres Verständnis der Sprache: Benutzer können natürlich sprechen, und der KI-Agent kann sie (oft) verstehen und ihre Absicht bei Bedarf umformulieren.

- Reichhaltigere, kontextuellere Textgenerierung: Der KI-Agent kann erklären, argumentieren, Geschichten erzählen usw., in einem fließenden, relevanten Stil.

- Anpassungsfähigkeit und Lernen: Dank Daten und angesammeltem Gedächtnis kann der Agent seine Antworten verbessern oder seine Handlungen anpassen.

Die wahre Revolution besteht jedoch nicht nur darin, einen einfachen Chatbot durch einen „Super-Chatbot“ zu ersetzen. Der entscheidende Wandel besteht darin, dass der KI-Agent über Entscheidungsmodule und Werkzeugaufrufe direkt in einer digitalen Umgebung eingreifen kann. Er kann Operationen orchestrieren, mit Informationssystemen interagieren und somit einen vollständigen und proaktiven Kundenservice oder Unterstützung bieten.

Konkrete Anwendungsfälle

1. Kundenservice und After-Sales-Support

In diesem Bereich kann ein KI-Agent:

- Eine Beschwerde eines Nutzers über ein defektes Produkt verstehen,

- Die Garantie- und Rechnungsinformationen in der Datenbank überprüfen,

- Eine Produktretoure (Tool Call) einleiten, indem er ein Logistikticket erstellt,

- Die Kundenakte aktualisieren, indem er den Anspruch protokolliert,

- Den Nutzer über das Verfahren informieren (oder ihm sogar eine Bestätigungs-E-Mail senden).

Das Ergebnis: ein 24/7-Kundenservice, der ein einheitliches und schnelles Erlebnis bietet und menschlichen Agenten Zeit für komplexere Fälle freigibt.

2. Verkaufs- und Marketingassistent

Stellen Sie sich einen KI-Assistenten vor, der in der Lage ist:

- Das genaue Bedürfnis des Kunden zu verstehen (ein bestimmtes Produkt, ein Sonderangebot usw.),

- Den Produktkatalog und die Verfügbarkeit zu überprüfen,

- Ein alternatives Produkt vorzuschlagen, wenn die erste Wahl nicht verfügbar ist,

- Die Bestellung aufzugeben oder ein Angebot vorzubereiten,

- Eine Bestätigungs-E-Mail mit einer Zusammenfassung zu senden.

Dieser KI-Agent fungiert als virtueller Super-Verkäufer, der den Kunden durch seine Kaufreise führt – von der ersten Informationsbeschaffung bis zur endgültigen Transaktion.

3. Fortgeschrittener technischer Support

Ein KI-Agent kann:

- Interne Wissensdatenbanken abfragen (technische Anleitungen, Handbücher, FAQs), um die geeignetste Lösung zu finden,

- Gezielt Fragen an den Nutzer stellen, um die Art des Problems besser zu verstehen,

- Fehlersuche-Schritte vorschlagen (und möglicherweise ein Fern-Diagnosetool ausführen),

- Das Support-Ticket aktualisieren und den Kunden über den Fortschritt informieren.

Dieses Szenario ist besonders nützlich im IT-Bereich oder im High-Tech-After-Sales-Service, wo die Komplexität der Fragen ein tiefes Verständnis des Problems und die Fähigkeit erfordert, die richtigen technischen Informationen zu finden.

4. Automatisierung administrativer Aufgaben

Ein KI-Agent könnte:

- Automatisch administrative Formulare ausfüllen,

- Daten aus Dokumenten (Rechnungen, Verträge usw.) extrahieren,

- Datensätze in einem HR- oder Buchhaltungsprogramm aktualisieren,

- Termine planen (Tool Call zu einem gemeinsamen Kalender),

- Erinnerungen oder Benachrichtigungen senden.

Diese Automatisierung reduziert die Belastung durch repetitive Aufgaben für die Teams erheblich und ermöglicht es ihnen, sich auf wertvollere Aufgaben zu konzentrieren.

Herausforderungen und Überlegungen

Obwohl das Versprechen von KI-Agenten verlockend ist, bleiben mehrere Herausforderungen bestehen:

- Qualität des Wahrnehmungsmodells: Selbst die besten LLMs können Fehler machen, Antworten erfinden oder eine Anfrage missverstehen.

- Aufrechterhaltung der Kohärenz über die Zeit: Je länger das Gespräch dauert, desto mehr muss der Agent einen großen Kontext verwalten und Inkonsistenzen vermeiden.

- Ethische und Sicherheitsfragen: Einem KI-Agenten die Fähigkeit zu geben, zu handeln, bedeutet potenziell, ihm Zugang zu sensiblen Daten oder kritischen Funktionen (Zahlungen, offizielle E-Mails usw.) zu gewähren. Daher ist es notwendig, Sicherheitsvorkehrungen zu treffen.

- Infrastrukturabhängigkeit: Die Zuverlässigkeit des KI-Agenten hängt von der Robustheit des Hostings und der Qualität der verwendeten Drittanbieter-APIs ab.

Um diese Herausforderungen zu bewältigen, implementieren Organisationen häufig hybride Lösungen, bei denen der KI-Agent bis zu einem bestimmten Schwellenwert arbeitet und dann sensible Aktionen zur Genehmigung an einen menschlichen Operator übergibt. Sie können auch alle Anfragen und Antworten protokollieren, um Prüfungen durchzuführen, falls ein Problem auftritt.

Warum in einen KI-Agenten investieren?

Trotz potenzieller Einschränkungen und Risiken entscheiden sich immer mehr Unternehmen dafür, einen KI-Agenten zu entwickeln oder zu integrieren. Hier sind einige wesentliche Vorteile:

- Verbesserte Kundenerfahrung: Ein KI-Agent kann 24/7 verfügbar sein, schnell und konsistent antworten und seine Antworten mithilfe des Gedächtnisses des Nutzers personalisieren.

- Kostenoptimierung: Durch die Automatisierung bestimmter Aufgaben reduzieren Sie die Arbeitslast für Ihre Teams und gewinnen an Produktivität.

- Zeitersparnis: Ein KI-Agent kann eine hohe Anzahl von Anfragen parallel bearbeiten, ohne müde zu werden, während er komplexe Fälle an Menschen übergibt.

- Innovation und Differenzierung: Ein intelligenter Kundenservice kann als starkes Marketingargument dienen.

- Bessere Datenerfassung: Der KI-Agent kann Gesprächsverläufe aufzeichnen und nützliche Statistiken (Fragentrends, Zufriedenheitsraten usw.) extrahieren.

Schlüsselprinzipien für die Implementierung eines effektiven KI-Agenten

- Den Umfang und die Ziele definieren: Welche Aufgaben muss der Agent übernehmen? Welche Aktionen sollte er ausführen können? Wie viel Autonomie wird ihm gewährt?

- Modelle auswählen oder trainieren: Verwenden Sie bestehende LLMs (bereitgestellt von großen Anbietern) oder trainieren Sie Ihr eigenes Modell mit internen Daten.

- Das „Entscheidungs“-Modul einbeziehen: Legen Sie die Geschäftslogik, Regeln und fest, wie der Agent verschiedene Tool-Calls orchestriert.

- Verbindungen zu Wissensdatenbanken herstellen: Richten Sie eine solide Wissensdatenbank-Infrastruktur ein – möglicherweise über einen Vektorindex oder ein internes FAQ-System.

- Sichern und überwachen: Verwalten Sie die Zugriffsrechte auf Tools und richten Sie eine Überwachung für die Antworten und Aktionen des Agenten ein.

- Die Nutzererfahrung berücksichtigen: Stellen Sie sicher, dass der Agent fließend und höflich kommuniziert und bei Zweifeln klärende Fragen stellen kann.

Die Rolle der Omnichannel-Integration

Ein KI-Agent muss auch dort sein, wo sich die Nutzer befinden. Das bedeutet, dass er in der Lage sein sollte, sich in folgende Bereiche zu integrieren:

- Eine Website (in Form eines Widgets oder Chatbots),

- Messaging-Plattformen (Messenger, Instagram, WhatsApp, Discord, Slack usw.),

- Einen privaten Kundenbereich (Intranets, Extranets),

- Geschäftssoftware (CRM, ERP, Helpdesk).

Dank dieser zahlreichen Integrationen wird der KI-Agent zu einem einzigen Ansprechpartner, der Konsistenz und Kontinuität in den Kundenbeziehungen bietet, egal welcher Kanal genutzt wird. Dies wird als Omnichannel-Ansatz bezeichnet, der die Nutzerreise optimiert und die allgemeine Zufriedenheit steigert.

Beispiele typischer Interaktionen

Um dies zu veranschaulichen, betrachten wir ein hypothetisches Szenario, in dem ein Nutzer den KI-Agenten über eine E-Commerce-Website kontaktiert:

- Nutzer: „Hallo, ich habe eine E-Mail erhalten, in der ich eingeladen werde, Ihren neuen Service auszuprobieren, aber ich verstehe nicht, wie er funktioniert.“

- KI-Agent: (Wahrnehmung) Versteht, dass es sich um eine Frage zu einem bestimmten Service handelt. (Entscheidung) Überprüft, ob interne Dokumentation verfügbar ist. (Wissensdatenbank) Findet einen Artikel, der erklärt, wie es funktioniert. (Antwortet) „Hallo, ich sehe, Sie haben Fragen zu unserem neuen Service. Hier sind die Schritte…“

- Nutzer: „Okay, aber wo kann ich meine Präferenzen festlegen?“

- KI-Agent: (Entscheidung) Identifiziert die Notwendigkeit, ein Profil zu aktualisieren. (Tool Call) Bietet einen Link an oder führt ein Skript aus, um die Präferenzen-Seite zu öffnen. „Sie können Ihre Präferenzen unter diesem Link aktualisieren. Möchten Sie, dass ich Sie direkt dorthin weiterleite?“

- Nutzer: „Ja, danke.“

- KI-Agent: (Gedächtnis) Merkt sich, dass der Nutzer seine Präferenzen aktualisiert hat, was später für personalisierte Empfehlungen nützlich sein wird.

In diesem Austausch sehen wir die Interaktion zwischen Wahrnehmung, Entscheidung, Wissensabruf und Tool-Calls, die alle im Gedächtnis des Agenten für zukünftige Referenzen archiviert werden.

Zukunftsperspektiven

AI-Agenten werden sich weiterentwickeln, insbesondere dank:

- Verbesserter LLMs: Genauere Modelle mit größerem Kontextverständnis und fortschrittlicherem Denken.

- Größerer Multimodalität: Ermöglicht es dem AI-Agenten, Bilder, Videos, Audios und nicht nur Text zu verarbeiten.

- Kontinuierlichem Lernen: Ermöglicht es dem Agenten, in Echtzeit aus neuen Daten oder Interaktionen zu lernen.

- Personalisierung: Nutzung detaillierter Benutzerprofile, kombiniert mit umfassenden Historien, um ein hyper-personalisiertes Erlebnis zu bieten.

- Entstehung von No-Code-Plattformen: Vereinfachung des Designs und der Bereitstellung von AI-Agenten, selbst für nicht-technische Benutzer.

In naher Zukunft kann man sich vorstellen, dass jedes Unternehmen sein eigenes Ökosystem spezialisierter AI-Agenten hat: einen für den Vertrieb, einen anderen für den technischen Support, einen dritten für das interne Management und so weiter. Diese Agenten könnten zusammenarbeiten und relevante Informationen austauschen, um das Kundenerlebnis und die interne Produktivität zu optimieren.

Fazit

AI-Agenten stellen einen bedeutenden Fortschritt im Bereich der angewandten künstlichen Intelligenz dar. Weitaus mehr als ein einfacher Chatbot kann ein AI-Agent die Benutzerabsicht verstehen, informierte Entscheidungen treffen, externe Tools nutzen und sich kontinuierlich durch kontextuelles Gedächtnis verbessern.

Mit der Weiterentwicklung der Technologie wird die Grenze zwischen einem virtuellen Assistenten, einem automatisierten Berater und einem digitalen Mitarbeiter verschwommen. Fortschritte in NLP und LLMs ermöglichen bereits die Entwicklung von Agenten, die ein breites Spektrum an Anwendungsfällen abdecken – von Kundenservice bis hin zur Verwaltung komplexer Geschäftsprozesse.

Vor diesem Hintergrund ist es entscheidend, AI-Agenten zu entwerfen, die robust, sicher und in der Lage sind, sich nahtlos in eine bestehende Umgebung zu integrieren. Die Herausforderungen in Bezug auf Governance, Zuverlässigkeit und Ethik dürfen nicht unterschätzt werden, doch sie schmälern nicht die Produktivitätsgewinne, verbessertes Kundenerlebnis und innovative Kapazitäten, die diese Technologien bieten.

Für Organisationen und Entwickler ist dies eine einzigartige Gelegenheit, sich abzuheben, indem sie intelligente Lösungen anbieten, die die Benutzerbedürfnisse von Anfang bis Ende wirklich ansprechen und alles nutzen, was moderne AI zu bieten hat. Mit dem Aufstieg von No-Code-Plattformen und müheloser Integration über verschiedene Kanäle hinweg können wir erwarten, dass AI-Agenten schnell zum Standard in der Kundenbeziehung und digitalen Transformation für Unternehmen werden.

Alles in allem beruht die erfolgreiche Implementierung eines AI-Agenten auf einer geschickten Kombination aus Technologie, Geschäftswissen, Integrationsstrategie und langfristiger Vision. Die Möglichkeiten sind vielfältig, und diejenigen, die sie nutzen, werden in der Lage sein, neue Dienstleistungen, neue Erfahrungen und neue Wege zu entwickeln, um mit Benutzern, Partnern und Mitarbeitern zu interagieren. Die Geschichte beginnt gerade erst, und es besteht kein Zweifel, dass AI-Agenten weiterhin an Reife und Raffinesse gewinnen werden – und allmählich neu definieren, wie wir Kommunikation, Zusammenarbeit und Automatisierung sowohl in unserem beruflichen als auch in unserem persönlichen Alltag angehen.